NVIDIA Orin平台 赋能人工智能应用软件开发的新引擎

随着人工智能技术的飞速发展,边缘计算与实时智能处理的需求日益增长。在这一背景下,NVIDIA Orin系列系统级芯片(SoC)应运而生,成为驱动下一代AI应用的核心硬件平台。作为一款专为高性能、低功耗边缘AI计算设计的处理器,Orin不仅集成了强大的计算能力,更以其完善的软件生态,为人工智能应用软件的开发带来了革命性的便利与可能。

一、NVIDIA Orin硬件平台概览

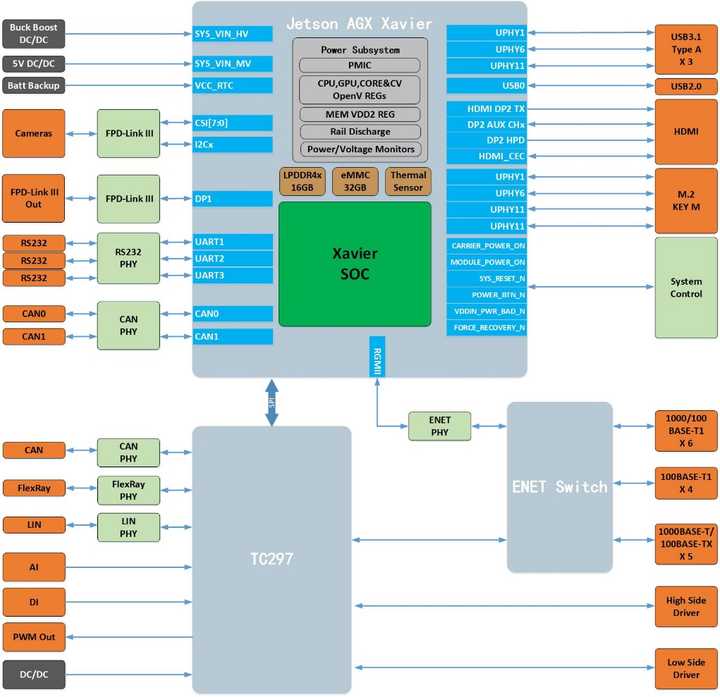

NVIDIA Orin基于先进的Ampere架构GPU和Arm Cortex-A78AE CPU核心构建,其算力最高可达275 TOPS(INT8),是前代产品Jetson Xavier性能的6倍以上。其强大的异构计算架构,整合了GPU、CPU、深度学习加速器(DLA)和可编程视觉加速器(PVA),能够高效并行处理复杂的AI推理、计算机视觉和传感器融合任务。Orin系列提供了从15W到60W不同功耗等级的模块(如Orin NX、Orin Nano和Orin AGX),覆盖了从入门级到高性能的各种边缘AI应用场景,如自主机器、智能零售、工业检测和高级辅助驾驶系统(ADAS)等。

二、面向AI应用开发的软件栈与工具链

NVIDIA为Orin平台构建了成熟且统一的软件生态系统,这是其核心优势所在。开发者无需从零开始,即可高效构建和部署AI应用。

- JetPack SDK:这是为Jetson系列(包括Orin)量身定制的核心软件开发工具包。它包含了基于Ubuntu的Linux操作系统、CUDA、cuDNN、TensorRT等关键库,为高性能计算和深度学习推理提供了坚实基础。JetPack确保了软件环境的一致性,简化了系统设置和依赖管理。

- NVIDIA AI软件栈:

- CUDA:统一的并行计算平台和编程模型,释放GPU的强大并行计算能力。

- TensorRT:高性能深度学习推理SDK。它能够优化训练好的神经网络模型,进行层融合、精度校准(支持INT8/FP16),显著提升推理速度并降低延迟,是部署到Orin等边缘设备的关键工具。

- DeepStream SDK:专为智能视频分析(IVA)应用打造。开发者可以利用它快速构建可扩展的多路视频流AI处理管道,实现物体检测、分类、跟踪等功能,广泛应用于安防、交通管理等场景。

- Isaac ROS/Isaac Sim:针对机器人开发的ROS加速包和高度逼真的虚拟仿真环境。开发者可以在Isaac Sim中利用数字孪生技术训练和测试机器人AI模型,再无缝部署到搭载Orin的实体机器人上,极大地加快了开发迭代周期。

- 预训练模型与迁移学习:NVIDIA NGC(NGC Catalog)提供了大量针对不同任务优化的预训练AI模型。开发者可以基于这些模型进行迁移学习,使用自己的数据集进行微调,从而以极小的数据量和计算成本,快速开发出满足特定需求的定制化AI应用。

三、AI应用软件开发流程与实践

基于Orin平台开发AI应用软件,通常遵循一个高效的流程:

- 模型训练与优化:在云端或高性能工作站上,使用PyTorch、TensorFlow等框架训练神经网络模型。训练完成后,利用TensorRT将模型转换为针对Orin硬件优化的格式,并进行量化、剪枝等优化以提升边缘推理效率。

- 应用开发与集成:使用C++或Python,结合DeepStream、Isaac ROS等SDK,编写核心业务逻辑。开发者可以方便地调用经过TensorRT优化的模型,处理来自摄像头、激光雷达等多传感器数据,并实现决策与控制输出。

- 仿真测试与验证:在投入实际部署前,利用Isaac Sim等仿真工具在虚拟环境中对整套AI系统进行大量、安全、可重复的测试,验证算法在复杂场景下的鲁棒性。

- 部署与运维:将开发好的应用程序打包,通过JetPack提供的工具链部署到Orin模块上。NVIDIA Fleet Command等云原生管理平台还能帮助管理者远程安全地部署、更新和监控大规模边缘AI设备集群。

四、优势与未来展望

选择NVIDIA Orin进行AI应用开发,主要优势在于其算力与能效的卓越平衡、从云端到边缘统一的架构(NVIDIA AI平台)以及极其丰富且不断进化的软件生态。这降低了AI落地的技术门槛和开发成本,让开发者能够更专注于算法创新与应用本身。

随着Orin平台的广泛采纳和其继任者(如基于新一代Blackwell架构的芯片)的演进,结合NVIDIA在Omniverse、生成式AI等领域的布局,边缘AI应用的开发将更加智能、实时和易于协同。NVIDIA Orin正持续为自动驾驶汽车、协作机器人、智慧城市等前沿领域的人工智能应用软件开发,提供着强大而可靠的动力源泉。

如若转载,请注明出处:http://www.cqxzlc.com/product/9.html

更新时间:2026-05-25 12:25:23